模型推理平台怎么选,是企业进入生成式 AI 服务化阶段后最容易高频出现的问题。很多团队前期只要能把模型跑起来,就会觉得推理侧没有太大门槛;但真正把模型能力开放给业务系统、智能体应用或外部用户后,平台压力会迅速从“能推理”升级成“能稳定推理、能低时延推理、能高峰扩容、能低谷降本”。此时平台选型如果只看支持哪些框架或能否启动模型实例,往往远远不够。企业真正要选的是一套能在性能、弹性、治理和工程集成之间取得平衡的推理平台。

在选平台前,先明确你的推理场景是哪一类

不同推理场景,对平台的要求差异非常大。若场景不分清,选型很容易失真。

在线实时推理

这类场景更关注延迟、可用性、峰值承载和流量治理。典型如智能问答、在线生成、推荐和实时决策接口。

批量离线推理

这类场景更关注吞吐、队列能力、任务成功率和资源利用率。典型如离线分类、批量抽取、日志分析、数据预处理。

混合型推理

很多企业同时存在实时与批量推理,平台需要同时兼顾低延迟和高吞吐,这时候资源隔离和弹性策略就会更重要。

如果没有先明确主场景,平台评估很容易停留在泛泛而谈。

模型推理平台选型,先看四类硬指标

一、延迟指标

低延迟不是一个抽象概念,要拆开看:

- 首 token 延迟

- 完整响应时延

- 高并发下的延迟波动

- 预热和冷启动开销

有些平台在单请求演示时看起来很快,但一到高峰并发和真实上下文长度下,延迟就会明显劣化。

二、吞吐指标

吞吐不仅决定单位时间内能处理多少请求,也直接影响平台成本结构。企业应关注:

- 单实例吞吐能力

- 批处理和连续批处理能力

- 多副本扩容后的线性增长情况

- 不同模型规模下的吞吐表现

三、资源利用率

平台若只能靠大量预留资源维持性能,长期成本会很高。更值得关注的是:

- GPU 利用率是否稳定

- 显存使用是否可控

- 不同副本规格是否容易调优

- 空闲时是否支持快速缩容

四、稳定性指标

推理平台最终要跑在生产环境,必须关注:

- 服务可用性

- 请求失败率

- 超时和队列堆积情况

- 模型实例异常恢复能力

为什么弹性伸缩是推理平台选型里的关键分水岭

很多平台都能跑推理,但真正拉开差距的,通常是弹性能力。

因为企业推理流量往往不是稳定常量,而是:

- 白天高峰、夜间低谷明显

- 大促、活动或业务波动带来短时峰值

- 新模型上线后请求量快速变化

- 某些接口调用量高度不均衡

此时平台若没有合理的弹性策略,就只能长期高配运行,成本会持续走高。

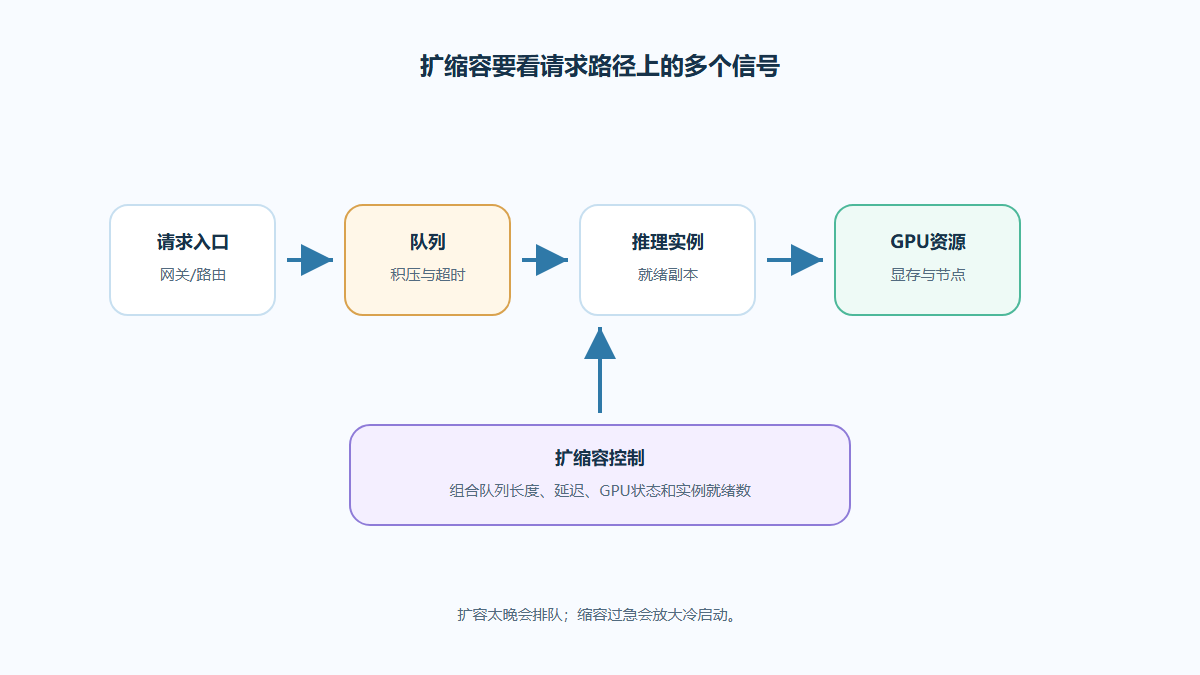

更值得重点看的弹性能力包括:

- 基于请求量、队列长度或 GPU 指标自动扩缩容

- 冷启动时间是否足够短

- 副本扩容后流量切换是否平滑

- 缩容时是否会中断长请求或影响会话体验

除了性能,服务治理能力同样不能忽略

推理平台进入企业后,不只是一个模型运行器,更是一套服务系统。服务治理能力至少要回答:

- 模型服务如何做版本切换和灰度

- 不同业务是否能共用一套入口

- 是否支持流量控制、限流和熔断

- 是否能对接网关、鉴权和审计体系

- 是否能把日志、监控、告警接入现有平台

很多选型失败,并不是性能不够,而是平台虽然能跑得快,却无法成为企业正式服务链路的一部分。

一个更实用的评估框架

为了避免只看 benchmark,可以用下面这个框架筛一轮。

| 评估维度 | 关键问题 | 重点看什么 |

|---|---|---|

| 场景匹配 | 主要服务实时还是批量场景 | 是否匹配主业务路径 |

| 延迟表现 | 高并发下是否稳定 | 首 token、尾延迟、抖动 |

| 吞吐能力 | 是否能支撑增长 | 批处理、并发、扩容后表现 |

| 弹性能力 | 是否能高峰扩、低谷缩 | 自动扩缩容与冷启动 |

| 服务治理 | 是否能进入正式生产链路 | 灰度、鉴权、监控、网关 |

| 工程集成 | 是否能和现有平台体系对接 | Kubernetes、日志、发布体系 |

这个框架的重点是把“跑模型”与“跑服务”区分开来。

企业最常见的几个误区

误区一:只看单机压测结果

单机结果只能说明局部性能,不代表真实生产效果。真正要看的是多副本、真实流量、长上下文和高峰场景下的表现。

误区二:只看吞吐,不看延迟波动

有些平台可以通过批处理把吞吐做得很好,但如果时延抖动很大,在线服务体验依然会受影响。

误区三:只看推理引擎,不看平台能力

推理引擎当然重要,但企业选的是平台,不只是 engine。部署方式、弹性机制、监控集成和治理边界同样关键。

误区四:一开始就追求支持所有模型

平台覆盖面广当然有价值,但对企业来说,更重要的是先把高频模型和关键场景跑顺,再逐步扩展支持范围。

一个更现实的落地顺序

如果企业准备正式建设模型推理平台,通常建议按下面顺序推进:

- 先明确主推理场景和服务目标

- 选定 1-2 类核心模型做平台验证

- 优先打通性能、弹性和监控三项基础能力

- 再补灰度、鉴权、流量治理等服务能力

- 最后再把更多模型类型和环境逐步纳入平台

这种方式更容易让平台先体现业务价值,而不是一开始就被复杂度压住。

结语

模型推理平台怎么选,关键不是谁能把模型先跑起来,而是谁能在真实业务场景下同时兼顾低延迟、弹性伸缩、服务治理和工程集成。对企业来说,一个真正可用的推理平台,应该既能稳定承接当前主业务模型,也能随着流量、版本和团队协作复杂度的上升持续演进。只有把平台选型放到生产服务视角里看,推理平台才不会沦为短期实验系统。

FAQ

模型推理平台和模型管理平台有什么区别?

模型推理平台更侧重模型服务运行、性能和弹性能力;模型管理平台更侧重模型资产、版本、权限和治理。两者通常需要协同,但关注重点不同。

企业最先该看低延迟还是高吞吐?

要看主场景。如果是在线交互式应用,低延迟通常更重要;如果是批量处理或后台任务,高吞吐往往优先级更高。很多企业最终需要两者兼顾,但不一定一开始就同等投入。

推理平台一定要基于 Kubernetes 吗?

不一定,但 Kubernetes 在弹性伸缩、资源编排和服务治理上有明显优势,因此很多企业最终会选择基于 Kubernetes 建设推理平台。