模型推理和模型训练有什么区别,是很多团队开始接触 AI 基础设施时必须先弄清楚的问题。读完本文,你可以快速判断三件事:模型训练和模型推理分别解决什么问题;为什么两者虽然都会用到 GPU,但资源模式、平台重点和指标目标完全不同;如果你的目标是企业级落地,为什么训练平台和推理平台通常不能按同一套思路建设。

写在前面

- 本文适用范围: 适合正在建设 AI 训练平台、模型推理平台、算力调度平台,或希望梳理模型生命周期分工的研发、算法和平台团队。

- 本文前置知识: 建议了解机器学习基础流程、模型部署和推理服务的基本概念。

- 本文评估口径: 本文重点从企业落地视角解释模型训练和模型推理的区别,不展开算法细节,而是强调资源、平台、部署和治理差异。

先说结论:训练是在生产模型,推理是在使用模型;两者虽然相关,但目标、资源模式和系统重点完全不同

如果只先记住一句话,可以直接记这句:模型训练的目标,是让模型学会能力;模型推理的目标,是让模型把能力稳定、快速、低成本地服务给真实请求。

从企业视角看,两者最核心的区别通常体现在:

- 目标不同:训练是产出模型,推理是提供服务

- 输入输出不同:训练输出模型权重,推理输出业务结果

- 资源模式不同:训练更像重型批处理,推理更像在线服务系统

- 平台重点不同:训练平台重实验和调度,推理平台重稳定性和成本控制

模型训练是什么

模型训练是指利用训练数据,让模型不断调整内部参数,从而学会某种任务能力的过程。

它通常包括:

- 数据准备

- 数据清洗和标注

- 特征处理

- 模型训练和参数更新

- 评估与调优

- 训练产物保存

训练阶段最核心的目标,是产出一个效果可接受、可复用、可管理的模型版本。也就是说,训练关注的重点不只是“跑完一次任务”,而是让模型在给定数据和目标下学到能力。

对企业来说,这一阶段通常更关注:

- 模型效果够不够好

- 训练过程是否可复现

- 数据和模型版本是否能追溯

- 训练资源是否可调度

- 训练成本是否可控

模型推理是什么

模型推理是指模型在训练完成后,接收用户输入或业务请求,并输出预测结果、生成内容或判断结果的过程。

例如:

- 用户发起文本生成请求

- 图像识别系统接收图片输入

- 推荐系统接收实时行为数据

- 智能体应用调用大模型完成回答或动作

推理阶段的重点,不是让模型继续学习,而是让模型稳定、快速、低成本地对外提供服务。对企业来说,这一阶段真正关心的往往是:

- 响应延迟是否可接受

- 并发能力是否足够

- 服务是否稳定

- 发布和回滚是否方便

- 成本是否能长期承受

两者最本质的区别是什么

如果把两者压缩成一句话,可以直接理解为:

- 训练: 让模型学会能力

- 推理: 让模型使用能力

也就是说:

- 训练更偏“生产模型”

- 推理更偏“提供服务”

这也是为什么很多团队虽然知道两者都和模型有关,但在真正做平台建设时仍然容易混淆。因为从表面看,它们都可能用 GPU、都涉及模型文件、都和 AI 系统相关;但从系统目标看,它们其实服务的是两条不同链路。

输入和输出为什么不一样

训练和推理不仅目标不同,输入输出也完全不同。

训练阶段的输入输出

训练通常输入:

- 大量训练数据

- 标注信息或反馈信号

- 训练参数和超参数

- 训练脚本和配置

训练输出:

- 新的模型权重

- 模型版本

- 训练日志和指标

- 评估结果

也就是说,训练的结果是模型本身,或者说是模型能力的一个新版本。

推理阶段的输入输出

推理通常输入:

- 用户请求

- 业务数据

- 上下文信息

- 已部署的模型版本

推理输出:

- 预测结果

- 生成内容

- 分类判断

- 排序结果

- 实时响应

所以推理更像是“把已经训练好的模型能力转化成业务输出”,而不是再去改变模型本身。

为什么资源消耗模式差别很大

训练和推理都可能使用 GPU,但它们的资源特征差别很大。

训练更关注什么

训练通常更关注:

- 大规模并行计算

- 长时间任务运行

- 高显存占用

- 多卡和多机协同

- 训练集吞吐效率

- 任务队列和调度效率

换句话说,训练更像一种重型计算任务,核心目标是把资源集中起来,在可接受时间内完成模型学习。

推理更关注什么

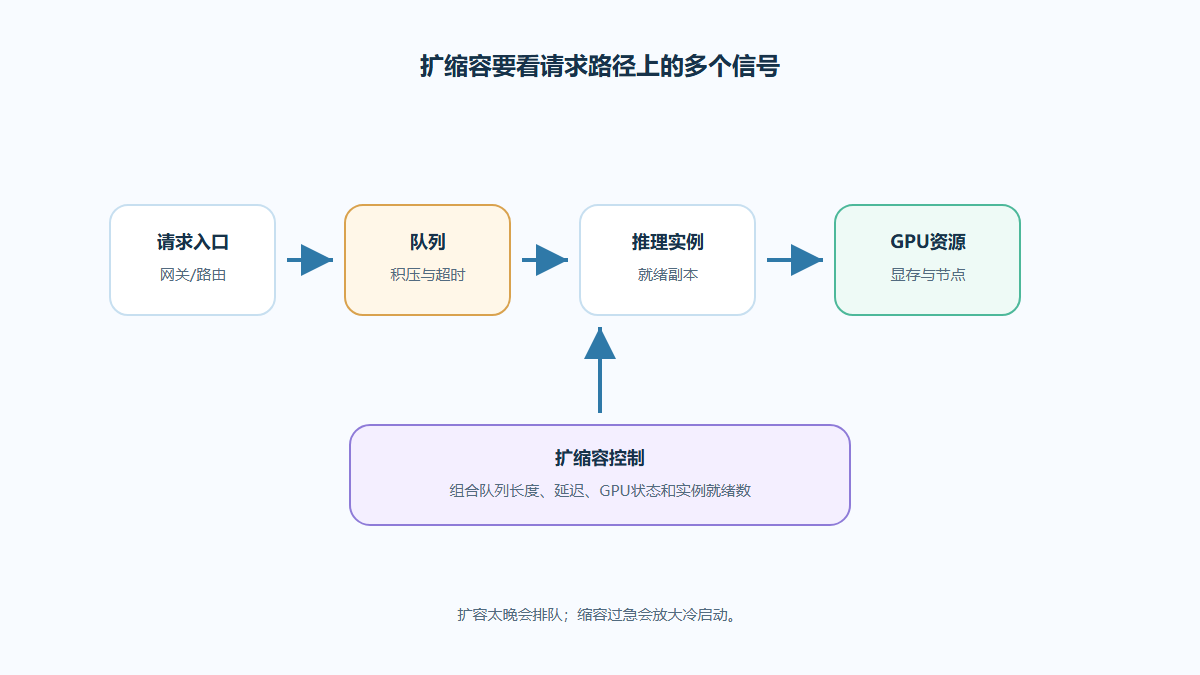

推理通常更关注:

- 请求延迟

- 并发处理能力

- 稳定性和可用性

- 弹性伸缩

- 成本控制

- 服务级别保障

也就是说,推理更像线上服务系统,重点不只是“能跑”,而是“能稳定跑、快速跑、低成本跑”。

这也是为什么训练资源配置方式通常不能直接照搬到推理环境里。训练可以接受任务排队和长时间执行,但推理往往要面对真实用户请求,容错空间更小。

如果从平台角度看,两者重点有什么不同

如果从平台建设视角看,训练平台和推理平台关注点也明显不同。

训练平台通常更关注

- 数据管理

- 训练任务调度

- GPU 资源分配

- 实验追踪

- 模型产物管理

- 分布式训练能力

- 训练日志和指标记录

推理平台通常更关注

- 模型部署

- 服务路由和流量分发

- 并发与弹性伸缩

- 灰度发布和回滚

- 监控告警

- 性能和成本优化

- 服务稳定性保障

因此,很多企业会把训练平台和推理平台分别建设,而不是简单当成同一回事。即使两者共享底层算力和基础设施,它们面向的工程问题也不一样。

企业为什么一定要把训练和推理分开理解

如果不分开理解训练和推理,平台建设很容易出现误判。

例如:

- 把训练资源配置方式照搬到推理环境

- 只重视训练效率,忽视线上推理稳定性

- 只看模型效果,忽视推理成本和延迟

- 忽视模型版本、发布和回滚管理

- 误以为训练成功就等于可以直接上线服务

而实际企业场景里,训练和推理通常服务于不同团队、不同链路和不同指标目标:

- 算法团队更关注训练效果和实验效率

- 平台团队更关注资源调度和基础设施能力

- 应用团队更关注推理稳定性、成本和业务指标

只有把这些差异看清楚,后面的 AI 平台、训练平台、推理平台和算力平台建设才不会跑偏。

训练和推理如何形成闭环

训练和推理虽然不同,但它们并不是割裂的。

更完整的闭环通常是:

- 收集数据

- 训练模型

- 评估模型并产出版本

- 发布模型到推理服务

- 监控线上效果

- 收集反馈和新数据

- 再训练并更新模型

这也是为什么企业会越来越重视 MLOps 和 LLMOps,本质上就是要把训练、部署、运行和反馈连接成持续迭代体系。

企业最容易踩的 4 个坑

1. 把训练成功当成上线成功

训练效果不错,不代表推理服务一定稳定。很多问题只会在真实流量和真实业务里暴露出来。

2. 只看 GPU 利用率,不看整体链路效率

训练和推理都要用资源,但关注点完全不同。只看单一资源指标,很容易忽略真正影响业务的瓶颈。

3. 只重视训练平台,不重视模型部署体系

如果部署、发布、回滚和监控能力不足,再好的模型也很难长期服务业务。

4. 没有建立从推理反馈回到训练的闭环

没有反馈闭环,模型上线之后就会逐渐老化,效果下降时也很难持续优化。

总结:训练解决“模型怎么学会能力”,推理解决“模型怎么稳定服务业务”

回到 模型推理和模型训练有什么区别 这个问题,最核心的答案就是:模型训练是在生产模型,模型推理是在使用模型。

训练更关注效果、参数学习和实验管理;推理更关注响应、稳定性、成本和发布治理。对企业来说,真正成熟的 AI 基础设施,不是只把模型训练出来,而是既能高效训练,也能稳定推理,并且让两者形成持续优化闭环。

FAQ

模型推理阶段模型还会继续学习吗?

通常不会。推理阶段的重点是使用已有模型输出结果,而不是继续更新参数。

训练和推理都一定要用 GPU 吗?

不一定,但大模型和高性能场景通常都会依赖 GPU。训练对 GPU 需求通常更高,推理则更关注性价比和延迟。

企业一定要分开建设训练平台和推理平台吗?

不一定,但很多企业会分别建设,因为两者关注点、资源模式和运行指标差别很大。

推荐内链

- MLOps是什么?

- LLMOps是什么?

- AI训练平台怎么搭建?

- 模型推理部署怎么做?